Obranná politika jako místo pro AI aneb Stane se Skynet realitou?

Americká vláda chce od Evropy, aby se výrazněji podílela na své obraně. Stávající 2 % HDP na obranné výdaje jsou minulostí, novým cílem je více než dvojnásobek. Haagský summit NATO tento týden má schvalovat výdaje na obranu na úrovni 5 % HDP členských zemí aliance. To znamená mimo jiné i vyšší výdaje do výzkumu v oblasti zbrojení, kde by se ve stále větší míře mohla zapojovat umělá inteligence (AI).

Umělá inteligence nachází uplatnění v mnoha oblastech, včetně vzdělávání, financí, dopravy, zdravotnictví, ale i národní bezpečnosti. Obranný sektor, klíčová součást širšího rámce národní bezpečnosti, zahrnuje vojenské schopnosti a operace zaměřené na ochranu svrchovanosti a zájmů státu.

Integrace AI do obranného sektoru ale znamená řadu výzev a také nákladů na vývoj. Spojené státy americké již dlouho staví svou národní bezpečnost na technologické převaze a AI se podle obranných strategií z let 2018 a 2022 stala klíčovým prvkem potřebným pro udržení vojenské dominance. Zatímco starší strategie zdůrazňuje využití AI ke zlepšení obranných operací, ta novější klade důraz na rychlé zavádění komerčních AI technologií.

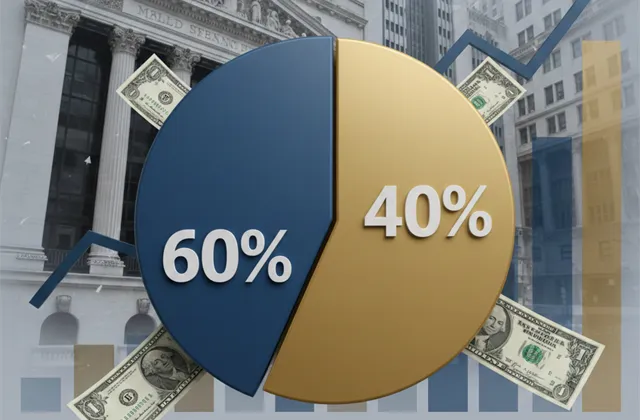

V roce 2022 tvořilo financování obranných inovací včetně AI přibližně 34 miliard USD (zhruba 4 % rozpočtu USA určeného na národní bezpečnost) a investice amerického ministerstva obrany do AI vzrostly z 600 milionů USD v roce 2016 na 1,8 miliardy USD v roce 2024 s více než 685 aktivními AI projekty. AI je přitom v USA integrována do široké škály oblastí, od průzkumu a kybernetických operací po autonomní systémy.

Čína staví AI přímo do centra své strategie dosažení "světové třídy armády" do poloviny 21. století. Investuje do autonomních vozidel, sledovacích systémů a dronů. Rusko výrazně zaostává, ale plánovalo do roku 2025 automatizovat 30 % výzbroje a posílit své schopnosti v oblasti autonomních zbraní a velení.

Nasazení AI v obranném sektoru přináší závažná rizika, která přesahují čistě technologickou rovinu a dotýkají se etiky, práva i geopolitické stability. Klíčové obavy zahrnují možnost porušování mezinárodního humanitárního práva ze strany autonomních zbraňových systémů, ztrátu lidské odpovědnosti a kontroly nad rozhodovacími procesy a také eskalaci konfliktů v důsledku rychlosti a nepředvídatelnosti AI systémů.

Dalším výrazným rizikem je kybernetická zranitelnost. AI může být cílem hackerských útoků nebo dezinformací, což by mohlo vést k fatálním selháním obranných operací. Technologie založené na AI mohou být navíc zatíženy datovými předsudky, což zvyšuje riziko diskriminace nebo nesprávného vyhodnocení situace.

Vývoj již předznamenávají i konkrétní kroky významných firem v oboru. OpenAI se vývojem jazykových modelů postupně posouvá do světa obranných kontraktů. Společnost nedávno získala zakázku od amerického ministerstva obrany, jejímž cílem je nasazení AI pro optimalizaci administrativy i bezpečnostních operací. Z modelu, který začal jako chatbot, se tak postupně stává infrastruktura pro novou generaci vládního i firemního řízení. A kdo ví, možná se časem bude sektor vyvíjet natolik, že někdejší sci-fi vize Skynetu z filmu Terminátor nebudou až tak daleko naplnění v realitě.

Aktuality